- SEO совет №1: Наличие карты сайта (Sitemap)

- SEO совет №2: Удобная навигация по сайту

- SEO совет №3: Наличие файла robots.txt

- SEO совет №4: Правильное использование ключевых слов

- SEO совет №5: Граммотная ссылочная стратегия

- SEO совет №6: Наличие заявление о конфиденциальности

- SEO совет №7: Отсутствие спама

- SEO совет №8: Проверка текста на дублирование (уникальность)

В дополнение к предыдущей статье «Оптимизация страницы сайта: 9 пунктов для сеошника» я решил выделить несколько ключевых пунктов, которые уже относятся не к оптимизации веб-страницы, а к оптимизации веб-ресурса в целом. По моему скромному мнению, это ключевые моменты, на которые нужно обращать внимание в первую очередь, приступая к оптимизации сайта.

SEO совет №1: Наличие карты сайта (Sitemap)

Карта сайта — файл, содержащий информацию о структуре сайта и страницах. Он представляет собой список всех URL-адресов на web-сайте, которые важны для индексации поисковиками. Sitemap представлен в формате XML, который чаще используется для обмена данными между веб-серверами и поисковыми системами.

Зачем нужна карта сайта:

- Предоставление полной информации о web-страницах веб-ресурса, что помогает быстрее и эффективнее индексировать контент.

- При её наличии поисковики быстрее обнаруживают новые веб-страницы.

- В некоторых случаях она используется для улучшения навигации пользователя.

Sitemap должен содержать информацию о всех типах страниц на веб-сайте, включая статические, блоговые, категории, теги и другие в зависимости от типа площадки. В некоторых случаях можно указать приоритет для индексации, что поможет поисковым системам определить, какие из них считать наиболее важными. Для её точной настройки используйте дополнительные теги: lastmod (дата последнего изменения), changefreq (частота изменений) и priority (приоритет).

На каждом web-сайте должен присутствовать Sitemap, в формате HTML или XML. Мэтт Каттс еще в 2009 году сказал, что Google не гарантирует 100% индексацию карты сайта в формате XML. Но с того времени многое могло измениться. Единственное, что не изменилось – это рекомендация: использовать на ресурсе обе карты: и HTML, и XML.

Заметка: путь к Sitemap можно указать в файле robots.txt через команду «:sitemap»

SEO совет №2: Удобная навигация по сайту

Чтобы обеспечить удобство использования и индексирование веб-сайта поисковиками, требуется уделить особое внимание структуре и оформлению навигационных элементов. Иерархическая структура навигации помогает пользователям и роботам лучше понять структуру веб-сайта, представляя собой древовидную систему, в которой веб-страницы разделены на категории и подкатегории.

- Текстовая навигация предпочтительнее для поисковых систем, так как она позволяет лучше понять структуру сайта и контент. Текстовые ссылки на главную страницу, категории и подкатегории должны быть чёткими и информативными.

- Меню должно быть легким и интуитивно понятным для юзеров. Важно предоставить им возможность поиска нужной информации с помощью меню и поиска. Это повышает удобство использования веб-сайта и уменьшает отказы пользователей.

- Также меню и ссылки должны быть адаптированы для мобильных устройств, чтобы юзеры могли легко перемещаться по сайту с любого устройства.

Навигацию по сайту лучше делать в текстовом формате. Если в дизайн веб-ресурса не вписывается текстовая навигация, то ее можно разместить в верхней части футера.

SEO совет №3: Наличие файла robots.txt

Это важная часть технической оптимизации, поскольку она контролирует, как роботы взаимодействуют со страницами.

Файл robots.txt представляет собой текстовый файл, расположенный в корневой директории веб-сайта и содержащий инструкции для роботов. Он указывает, какие web-страницы или разделы следует индексировать, а какие нет. Также он может содержать местоположение Sitemap и другие инструкции, влияющие на индексацию.

Для управления индексацией в файле robots.txt используются директивы:

- «disallow» указывает поисковикам не индексировать определенные разделы или страницы веб-ресурса;

- директива «Allow» позволяет включить доступ к ресурсам, которые по умолчанию могут быть заблокированы.

Пример файла robots.txt:

User-agent: *

Disallow: /cgi-bin/

Disallow: /tmp/

Disallow: /private/

Этот пример запрещает роботам индексировать разделы «/cgi-bin/», «/tmp/» и «/private/».

После создания или изменения этого файла рекомендуется использовать инструменты для проверки корректности. Google Search Console предоставляет возможность просмотра и анализа файла.

Наличие данного файла очень важно, даже если он пустой. В robots.txt можно указать поисковому роботу, что нужно индексировать, а что нельзя. Но главное надо убедиться, что в данном файле случайно не закрыта от индексирования важная информация, директория или полностью сам веб-ресурс (ведь и такое бывает!).

SEO совет №4: Правильное использование ключевых слов

Ключевые слова помогают поисковикам понять тематику страницы и определить её релевантность для конкретных запросов пользователей. Подбор ключевиков — процесс выбора слов или фраз, которые наиболее точно описывают содержимое веб-страницы и соответствуют запросам. Рекомендуется использование ключей в:

- заголовках страницы (H1, H2 и т. д.) и мета-тегах (title, description);

- тексте естественным образом, чтобы они органично вписывались в контекст. Избегайте излишнего повторения, чтобы не создавать впечатление спама;

- URL-адресах web-страниц, чтобы они были информативными и помогали лучше понять содержимое;

- анкорных текстах ссылок для улучшения их релевантности.

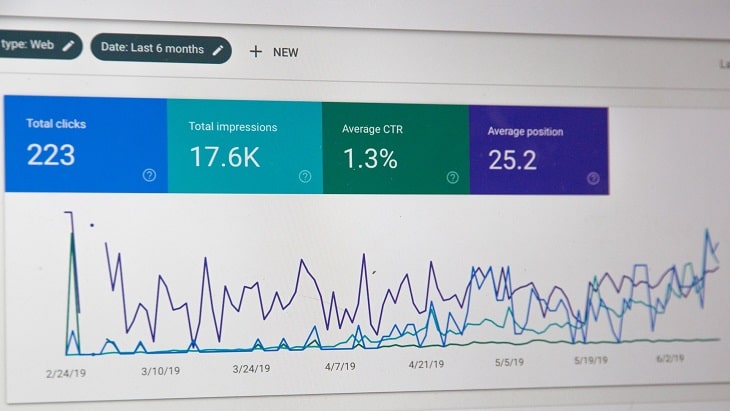

Следите за результатами использования ключевых слов с помощью аналитических инструментов, чтобы оценить их эффективность и внести коррективы при необходимости. Периодически пересматривайте их использование и вносите корректировки, если обнаруживаете неэффективное использование или изменение требований поисковиков.

Правильный подбор и размещение ключей на странице — целая наука. Не нужно заниматься переспамом и их концентрацией в определенном месте на веб-странице, так как это чревато последствиями со стороны поисковиков.

SEO совет №5: Граммотная ссылочная стратегия

Она играет особую роль в успешной SEO оптимизации, включая в себя два аспекта: внутренняя перелинковка и получение внешних ссылок.

Внутренняя перелинковка — создание ссылок между страницами одного web-сайта, что помогает поисковым системам понять структуру и важность различных web-страниц. Её основной целью является распределение авторитета между страницами и улучшение пользовательского опыта.

Правила и принципы внутренней перелинковки:

- Ссылки должны быть релевантны веб-странице, на которую они указывают.

- Включение ключевых слов в текст ссылок улучшит их вес в глазах поисковиков.

- Они должны быть легко обнаруживаемыми и понятными для пользователей.

- Использование якорей (anchor text) уточняет их контекст и улучшить релевантность.

Внешние ссылки (backlinks) один из наиболее важных факторов ранжирования в поисковых системах, представляя с собой ссылки на ваш веб-сайт с других веб-ресурсов.

Правила и принципы получения бэклинков:

- имеют больший вес, чем множество ссылок с низкокачественных ресурсов;

- ссылки с ресурсов, тематика которых соответствует веб-ресурсу, имеют больший вес;

- поисковики ценят естественность их получения. Искусственное создание ссылочной массы может быть расценено как нарушение правил и привести к снижению ранжирования.

На сайте всегда должна быть грамотная внутренняя перелинковка web-страниц.

SEO совет №6: Наличие заявление о конфиденциальности

Цель заявления — обеспечить юзеров информацией о том, какие персональные данные собираются, для чего они используются и как они защищены, помогая вызвать доверие у пользователей и соблюсти требования законодательства о конфиденциальности.

Оно должно содержать следующие элементы:

- Какие данные собираются (например, имя, адрес электронной почты, номер телефона) и как они используются.

- Для чего собираются данные (например, для обработки заказов, обратной связи с пользователями).

- Какие методы используются (например, через формы обратной связи, регистрационные формы).

- Какие права имеют юзеры относительно своих данных (например, право на доступ, исправление или удаление).

- Какие меры защиты принимаются для обеспечения их безопасности.

Заявление о конфиденциальности имеет значение для SEO, поскольку системы учитывают его наличие и качество при определении релевантности и надежности web-сайта.

По некоторым данным, «Заявление о конфиденциальности» является важным элементом на сайте. Если в регистрационных формах есть просьба к посетителю ввести личную информацию, то обязательно должно быть уведомление, что информация будет использоваться только этим веб-ресурсом, и ни при каких обстоятельствах не будет передаваться третьим лицам.

SEO совет №7: Отсутствие спама

Злоупотребление ключевыми словами в контенте или метатегах веб-страницы с целью повышения релевантности для запросов.

- Скрытый текст, который не виден для пользователей, но виден поисковикам. Этот текст может быть скрыт с помощью цвета текста, фона или CSS-стилей.

- Участие в ссылочных сетях с целью искусственного увеличения ссылочной массы.

- Публикация одного и того же текста на разных урлах или на различных сайтах с целью увеличения количества индексируемых страниц или ссылочной массы.

Последствия спама:

- поисковые системы негативно реагируют на спам и в результате web-сайт может быть понижен в выдаче или вообще исключен из индекса;

- может повлиять на доверие пользователей к нему, что приведёт к уменьшению посещаемости и конверсии;

- в случае обнаружения спама поисковики наложат штрафы, что может серьёзно навредить репутации и позициям в результатах поиска.

Следует убедиться, что выбранная SEO стратегия соответствует параметрам и требованиям Google Webmaster Guidelines. Если возникают какие-то сомнения или вопросы по поводу SEO, обратитесь к статье Google accepts for SEO.

SEO совет №8: Проверка текста на дублирование (уникальность)

Уникальный контент — один из главных факторов SEO оптимизации. Повторяющийся или дублирующий текст негативно скажется на ранжировании web-сайта в поисковых системах, поэтому важно проверять его на уникальность и предпринимать меры по устранению. Уникальный контент считается более ценным, так как предоставляет информацию, которую пользователи могут считать полезной и интересной. Кроме того, он формирует авторитет сайта в глазах систем, что положительно сказывается на ранжировании.

Существует способ проверки уникальности — использование специализированных онлайн-сервисов:

- Copyscape.

- Plagium.

- SmallSEOTools.

Если при проверке контента обнаружены дубликаты, необходимо:

- изменить или переписать контент таким образом, чтобы он стал уникальным;

- удалить дублирующий контент, если он не несет ценности;

- использовать атрибуты rel=»canonical» для указания основной веб-страницы, если контент является вариацией уже существующего;

- использовать редиректы 301 для перенаправления с дублирующих web-страниц на основные.

Контент должен быть уникален. Проверить его можно как с помощью online сервисов, так и с помощью программ.